توییچ (Twitch) چیست؟

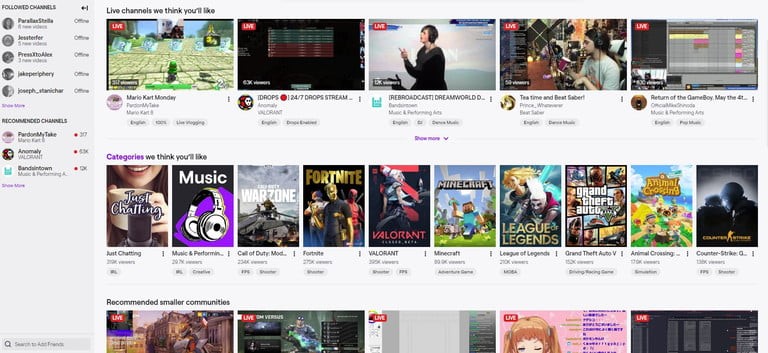

Twitch برنامه ایست که در آن بازی های ویدیویی دست به دست هم می دهند و با داشتن میلیون ها بیننده و بازی کننده راهی برای تعامل و به اشتراک گذاری محتوای خلاقانه با دیگران ارائه می دهند. Twitch اخیراً محبوبیت زیادی کسب کرده است و پرکاربردترین پلتفرم برای پخش بازیهای ویدیویی شناخته می شود.

Twitch در سال ۲۰۱۱ تاسیس شده و بستری برای پخش مستقیم ویدئو می باشد، در این پلتفرم تقریباً هر چیزی را که می خواهید تماشا کنید، از آشپزی گرفته تا موسیقی، جلسات پرسش و پاسخ، رانندگی در ترافیک و بازی های ویدیویی را به شما ارائه می دهد. در ابتدا به عنوان بخش spinoff Justin.tv با اولویت اصلی بازی شروع به کار کرد. Twitch در زمانی کوتاه چنان محبوب گشت که این محبوبیت منجر به ایجاد یک مارک تجاری کامل در Justin.tv شد و در سال ۲۰۱۴ نام خود را به Twitch Interactive تغییر داد. سپس در همان سال Twitch Interactive توسط آمازون خریداری گشت. به طور متوسط Twitch بیش از ۱۵ میلیون کاربر فعال روزانه دارد.اما اگر می خواهید بدانید Twitch دقیقاً چیست؟ و چطوری کار می کند؟ در این مقاله، تمام آنچه را که باید در مورد این پلتفرم بدانید به شما خواهیم گفت.

نحوه دسترسی به Twitch

Twitch برای تمامی سیستم عامل ها در دسترس می باشد. برای تماشای این روند ها می توانید به وب سایت رسمی Twitch مراجعه کنید یا اینکه از این برنامه ی پر مخاطب درiOS ،Android ، Windows ،Mac ،PS4 ، Xbox One و دستگاه هایی مانند Chromecast و Apple TV که در دسترس است استفاده کنید. اگر دستگاه شما به اینترنت دسترسی دارد و از برنامه ها پشتیبانی می کند احتمالاً می توانید به راحتی از آن برای تماشا و بازی در Twitch استفاده کنید.

چه استریمر باشید یا تنها یک بیننده ایجاد یک حساب کاربری Twitch برای همه رایگان است. برای نظر دادن در مورد stream ها و همچنین اشتراک یا دنبال کردن محتوای دیگران، شما ابتدا به یک حساب نیاز دارید.

چرا توییچ؟

دنبال کردن آخرین بازی های ویدیویی می تواند برای شما گران و وقت گیر تمام شود. به همین دلیل، بسیاری از گیمرها با Twitch هماهنگ می شوند تا ببینند آیا بازی برای آنها مناسب است یا خیر. بعضی اوقات خواندن در مورد یک بازی یا تماشای فیلم ضبط شده از آن کافی نیست بهتر است تا گیمر ها برا آشنایی بهتر با بازی آن را بصورت عملی تجربه کنند، و این همان جایی است که Twitch وارد عمل می شود.این نکته را هم به خاطر داشته باشید که stream ها فقط مختص بازی نیستند بلکه بسیاری از موسیقی دانان مشهور، به دلیل لغو همه تورها برای کسب درآمد در طول بیماری همه گیر COVID-19 به Twitch رو آورده اند.

برخی از streamer ها دسترسی زودهنگام به یک بازی جدید را پیدا می کنند و در ازای تبلیغات رایگان برای این بازی با ناشر آن شریک می شوند. تماشای استریم بازی مورد علاقه تان در این پلتفرم ها می تواند به شما کمک کند تا تصمیم آگاهانه تری برای خرید آن بگیرید.

البته خوب است این موضوع را نیز بدانید که stream معمولاً با یک گپ و گفتگوی مستقیم همراه خواهد بود که در آن بینندگان می توانند با streamer و سایر افرادی که در حال تماشا هستند ارتباط برقرار کنند.

کسب درآمد از توییچ (Twitch)

مهمترین تغییر در استفاده از شبکه های اجتماعی طی چند سال گذشته افزایش بسیار زیاد تعداد ویدیوهای به اشتراک گذاشته شده و دیده شده در فضای مجازی می باشد. در حالی که بیشتر این موارد شامل اشتراک گذاری فیلم ها توسط مردم در سیستم عامل هایی مانند YouTube و Facebook بوده است، اما در تعداد stream ها نیز افزایش قابل توجهی مشاهده شده است.

یکی از چیزهایی که طرفداران تکنولوژی و فن آوری را به خود جلب می کند، بازی ها می باشند. بنابراین جای تعجب نیست که گیمرها سریعتر از اکثر ژانرهای دیگر به stream روی آورده اند. Twitch دقیقا همان پلتفرم استریم مورد نظر برای گیمرها است.

پخش کننده های بازی کشف کرده اند که چگونه می توانند در Twitch پول بدست آورند. این برنامه یا پلتفرم می تواند بستری سودآور برای گیمر ها باشد. همچنین درصد کمی از کاربران Twitch موفق می شوند که در مکان های غیراز بازی در این پلتفرم معروف شوند.

برخی از گیمرهای معروف به وضوح فرمول کسب درآمد خوب در Twitch را پیدا کرده اند، و فقط از مشترکان ماهیانه خود بیش از ۱۰۰۰۰۰ دلار هزینه دریافت می کنند. هنگامی که حمایت مالی و سایر تکنیک های پول سازی را اضافه می کنید، تأثیرگذاران برتر Twitch درآمد قابل توجهی را در این راه کسب می کنند.

انواع کاربر در توییچ

توانایی شما برای کسب درآمد از Twitch تا حدود زیادی به نوع کاربری شما بستگی دارد. می توان کاربران Twitch را به گونه ی زیر تقسیم کرد:

- کاربران روزمره Twitch

- شرکت های وابسته Twitch

- همیاران Twitch

کسب درآمد از توییچ (twitch) به عنوان یک تازه وارد

وقتی مخاطب شما رشد می کند، پتانسیل شما هم برای کسب درآمد افزایش پیدا می کند. اما چند روش کلی و ساده وجود دارد که کاربران جدید می توانند از طریق آن به کسب درامد مشغول گردنند:

- کمک های مالی

کاربران Twitch دوست دارند که بتوانند از خودشان در این پلتفرم پشتیبان کنند. یکی از راه های اصلی انجام این کار کمک مالی بهstream های مورد علاقه خود است. یک دکمه “اهدا” به کانال خود اضافه کنید و از طریق PayPal یا یک برنامه شخص ثالث مانند Streamlabs ه به بینندگانتان اجازه دهید تا از کارهای شما حمایت مالی کنند.

- مشارکت تجاری

شرکت ها برای پخش محصولات خود و قرار دادن بیشتر آنها در معرض دید مردم از پخش کننده های Twitch استفاده می کنند و در ازای آن، از استریمر ها می خواهند تا محصول انها را تبلیغ کنند.

این تبلیغات می تواند از طرف شرکت هایی باشد که سخت افزار و نرم افزار، نوشیدنی های انرژی زا و لوازم جانبی تولد می کنند و می خواهند بدین طریق فروش خود را بالاتر ببرند.

- کالا

اگر در کانال Twitch خود مخاطبان اختصاصی دارید می توانید به راحتی کالاهای خود را بفروشید. این کالا ها می تواند شامل انواع تی شرت، برچسب، لیوان قهوه و و غیره باشد.

نتیجه گیری

اگر بخواهم بصورت خلاصه برایتان شرح دهم Twitch یک پلتفرم بسیار مناسب برای گیمرها می باشد، با بیش از ۴ میلیون استریمر ماهانه و ۱۷.۵ میلیون کاربر روزانه که همه در حال بازی یا تماشای افراد دیگر در حال بازی های ویدیویی می باشند. همچنین این پلتفرم برای گیمرهایی است که امیدوارند بتوانند اندکی پول به واسطه ی سرگرمی مورد علاقه شان کسب کنند.