خطای HTTP 451 چیست؟

کد وضعیت ۴۵۱ که در پروتکل HTTP بر روی سایتها مشاهده میشود، بیانگر این است که منبع درخواست شده بنابه دلایل حقوقی و قانونی، قابل دسترسی نیست.

نشانههای خطای ۴۵۱:

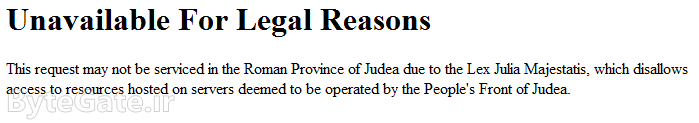

خطای ۴۵۱ (Error 451) یا “Unavailable For Legal Reasons” که به معنای “در دسترس نبودن بخاطر دلایل قانونی” میباشد، یکی از کدهای وضعیت HTTP است که به عنوان خطا شناخته میشود. خطای ۴۵۱ ممکن است در همه سیستم عاملها با همه مرورگرها پدیدار شود؛ زیرا این خطا از سمت سرور به سمت کاربر هدایت میشود. این خطا با پیغامهای مختلفی ممکن است همراه شود. از جمله رایج ترین پیغامهای آن در مرور گرها موارد زیر است:

- Unavailable 451

- Error 451

- HTTP 451

- Unavailable For Legal Reasons

خطای ۴۵۱ چیست؟

همانطور که میدانید، خطای ۴۰۳ یا Forbidden زمانی به کاربر تحویل داده میشود که کاربر دسترسی به منبع (صفحه وب، عکس، فایل و …) درخواستی نداشته باشد. با این حال این خطا دلیل مشخصی برای در دسترس نبودن منبع به کاربر نمیدهد.

در نوامبر ۲۰۱۵ برای یکی از موارد در دسترس نبودن، کد وضعیت ۴۵۱ معرفی شد (داکیومنتها). کد وضعیت (یا خطای) ۴۵۱ زمانی به کاربر تحویل داده میشود که در دسترس نبودن منبع درخواستی از روی غیرقانونی یا بلاک شدن آن توسط دولت باشد مثلاً زمانی که فردی میخواهد به یک سایت فیلتر شده یا سایتی که از نظر دولت غیر قانونی شناخته شود مراجعه کند، خطای ۴۵۱ به مرورگر وی ارسال خواهد شد.

با این که استفاده از این کد وضعیت توسط شرکتها و نهادها هنوز رایج نشده اما میتواند کمک زیادی به کاربران بکند. فرض کنید سایت The Pirate Bay (یکی از منابع مهم به اشتراک گذاری فایلهای تورنت) توسط دولتی فیلتر یا سانسور شود. در گذشته طرف شرکت ارائه دهنده خدمات اینترنتی (ISP) که کاربر از آن استفاده میکرد، بنابه دلخواست قضایی دسترسی کاربر را به آن سایت منع کرده و بجای آن خطای Forbidden 403 تحویل کاربر میداد. با این حال کاربر نمیدانست که چرا به آن منبع دسترسی ندارد و برایش مبهم میشود. حال با ارسال کد وضعیت Unavailable 451 میتوان به کاربر گفت که خطا از کجاست؛ این منبع فیلتر شده است.

در ایران نیز کارگروه تعیین مصادیق مجرمانه (مسئول فیلترینگ سایتها) و ISPهای مختلف میتوانند از کد وضعیت ۴۵۱ بجای ۴۰۳ کنونی استفاده کنند.