Ollama چیست و چگونه از آن در ویندوز استفاده کنیم؟

اگر میخواهید مدلهای زبانی بزرگ یا LLM را روی کامپیوتر خود اجرا کنید، یکی از سادهترین راهها استفاده از Ollama است. Ollama یک پلتفرم قدرتمند اوپن سورس است که یک تجربه هوش مصنوعی قابل تنظیم و قابل دسترسی را ارائه میدهد. این پلتفرم دانلود، نصب و تعامل با مدلهای زبانی مختلف را بدون نیاز به تکیه بر پلتفرمهای مبتنی بر ابر یا داشتن تخصص فنی آسان میکند.

علاوه بر مزایای فوق، Ollama بسیار سبک است و به طور منظم بهروزرسانی میشود، که این امر آن را برای ساخت و مدیریت LLMها روی دستگاههای محلی بسیار مناسب میکند. بنابراین، شما نیازی به سرورهای خارجی یا تنظیمات پیچیده ندارید. Ollama همچنین از چندین سیستم عامل از جمله ویندوز، لینوکس و macOS و همچنین محیطهای مختلف Docker پشتیبانی میکند. برای یادگیری نحوه استفاده از Ollama برای اجرای LLMها روی دستگاه ویندوز خود، ادامه مطلب را بخوانید.

دانلود و نصب Ollama

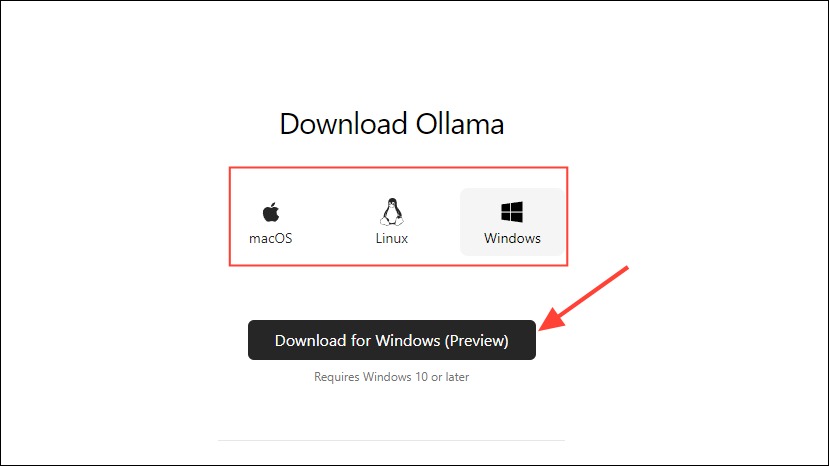

۱- ابتدا از صفحه دانلود Ollama دیدن کنید و قبل از کلیک بر روی دکمه Download سیستم عامل خود را انتخاب کنید. همچنین، میتوانید Ollama را از صفحه GitHub آن دانلود کنید. پس از اتمام دانلود، آن را باز کرده و بر روی دستگاه خود نصب کنید.

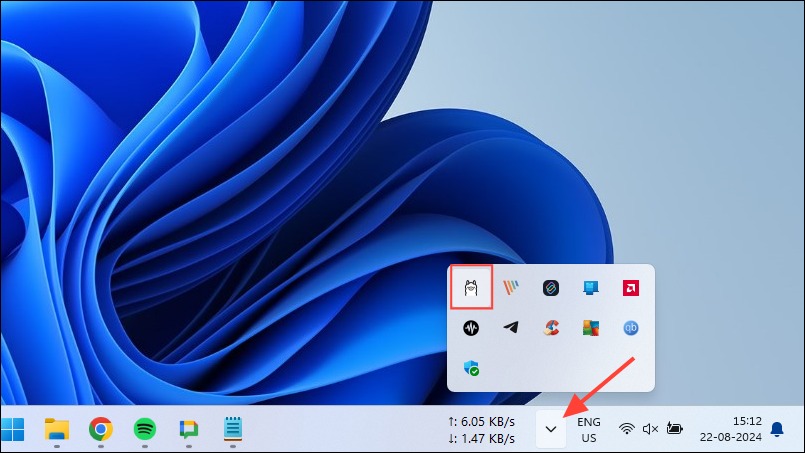

۲- در ویندوز، با کلیک بر روی دکمه آیکون های مخفی در نوار وظیفه، می توانید بررسی کنید که Ollama در حال اجرا است یا خیر.

سفارشی سازی و استفاده از Ollama

هنگامی که Ollama بر روی کامپیوتر شما نصب شد، اولین کاری که باید انجام دهید این است که محل ذخیره داده های خود را تغییر دهید. بهطور پیشفرض، مکان ذخیرهسازی C:\Users\%username%\.ollama\models است، اما از آنجایی که مدلهای هوش مصنوعی میتوانند بسیار بزرگ باشند، درایو C شما میتواند به سرعت پر شود.

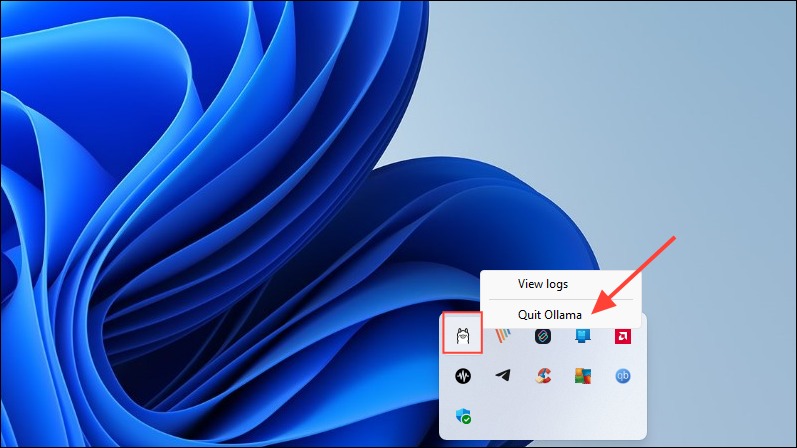

۱- برای انجام این کار، ابتدا بر روی آیکون Ollama در نوار وظیفه کلیک کنید و روی Quit Olama کلیک کنید.

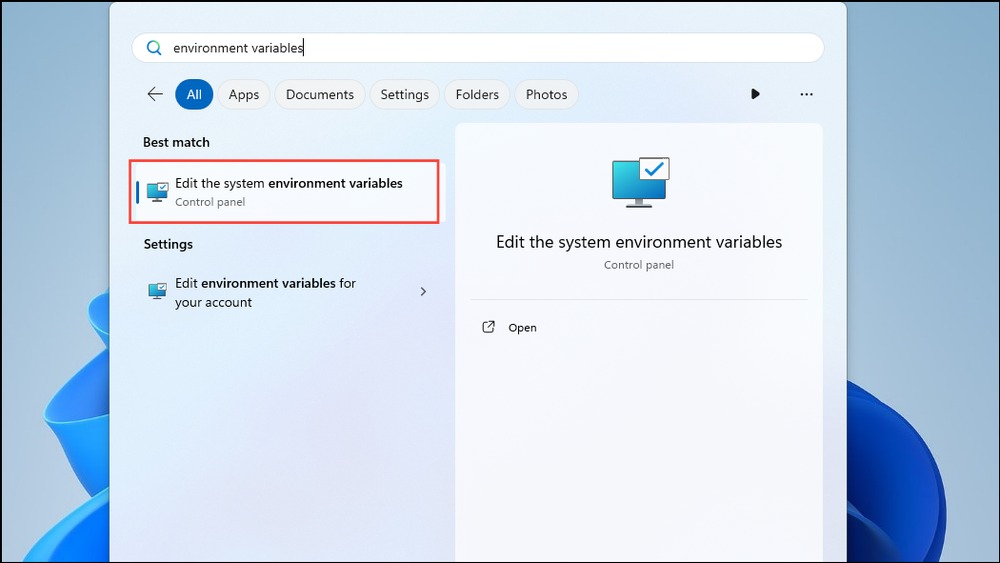

۲- پس از خروج از اولاما، منوی استارت را باز کنید، environment variables را تایپ کنید و روی Edit the system environment variables کلیک کنید.

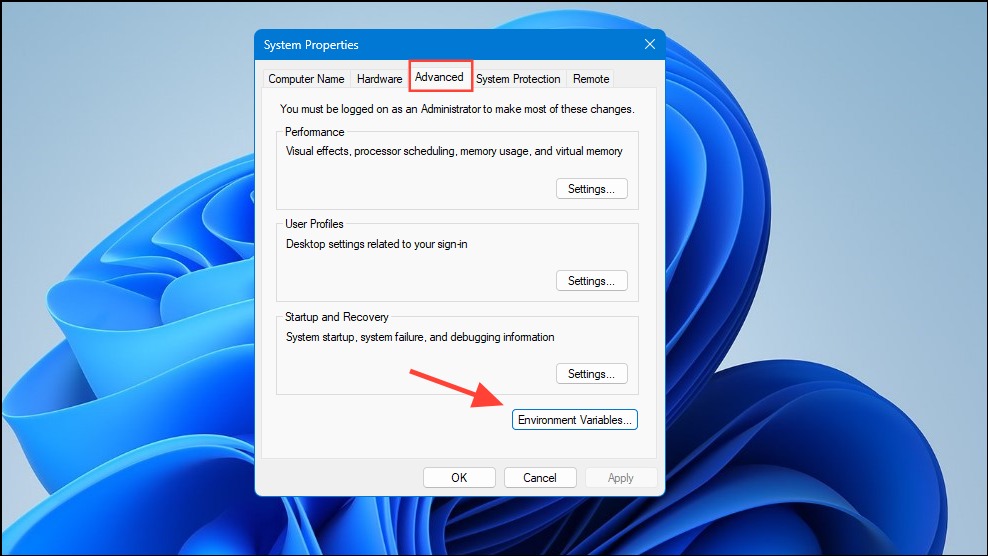

۳- وقتی پنجره متغیرهای سیستم باز شد، روی دکمه Environment Variables در تب Advanced کلیک کنید.

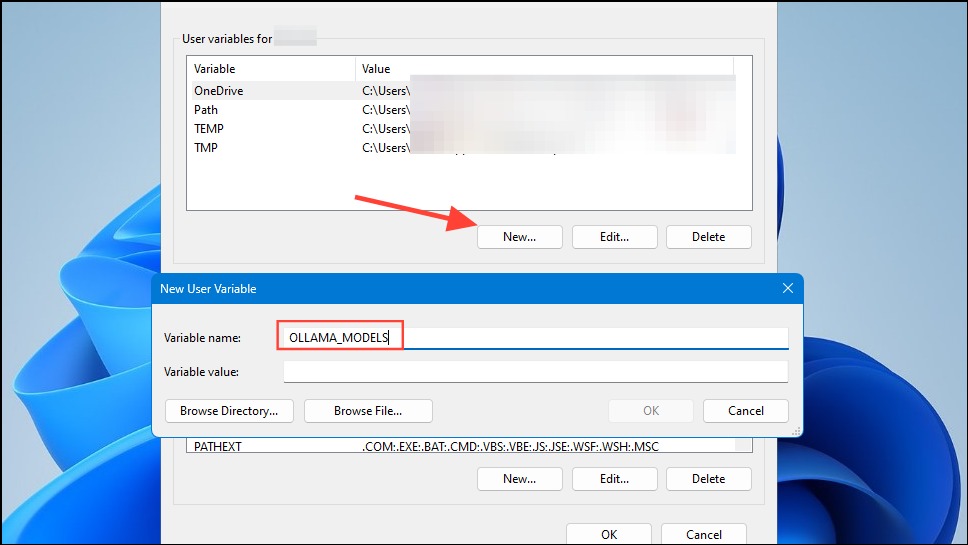

۴- روی دکمه New برای اکانت خود کلیک کنید و یک متغیر به نام OLLAMA_MODELS در قسمت Variable name ایجاد کنید.

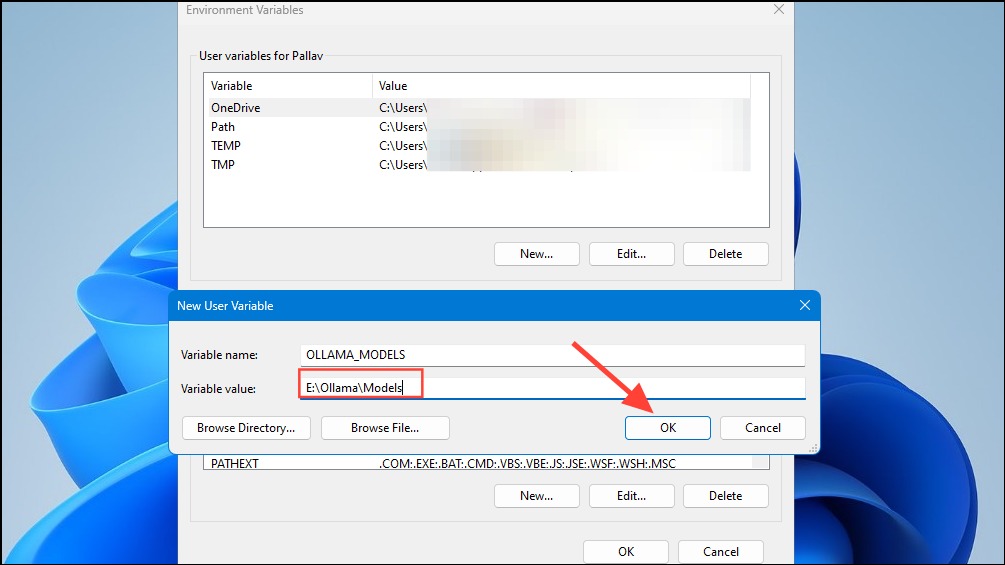

۵- سپس مکان دایرکتوری که میخواهید Olama مدلهای خود را ذخیره کند را در قسمت Variable value تایپ کنید. سپس قبل از راه اندازی Olama از منوی Start، روی دکمه OK کلیک کنید.

توجه: همچنین میتوانید سایر متغیرهای سیستم را برای Ollama تنظیم کنید، مانند ‘Ollama_Host’، ‘Ollama_Port’، ‘Ollama_Origins’، ‘Ollama_Debug’، و موارد دیگر.

۶- اکنون شما آماده شروع استفاده از Ollama هستید و می توانید این کار را با Llama 3 8B متا، آخرین مدل هوش مصنوعی اوپن سورس این شرکت انجام دهید. برای اجرای مدل، یک پنجره خط فرمان، Powershell یا Windows Terminal را از منوی Start اجرا کنید.

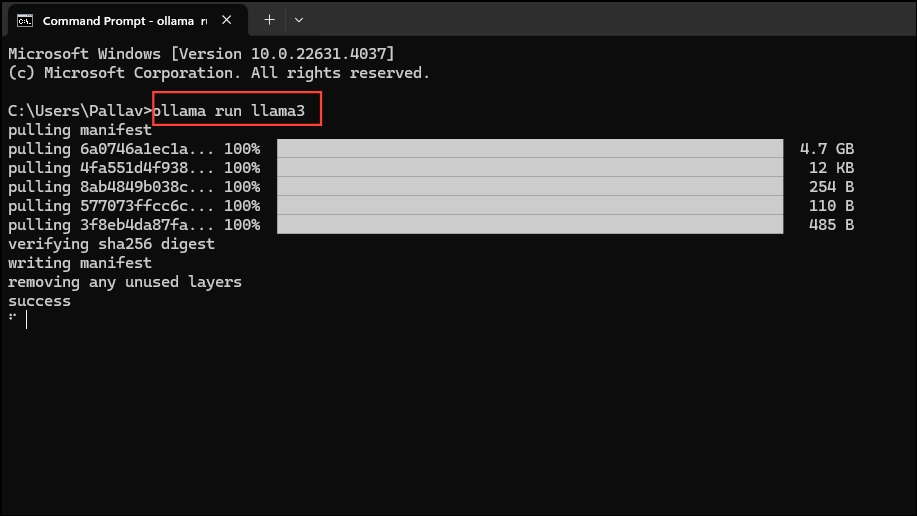

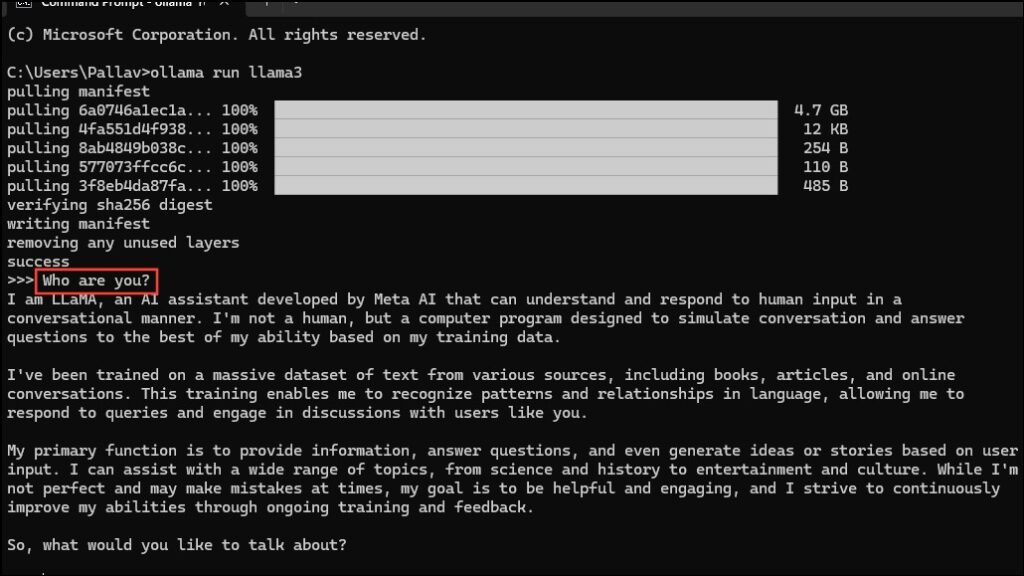

۷- هنگامی که پنجره خط فرمان باز شد، ollama run llama3 را تایپ کرده و Enter را فشار دهید. مدل نزدیک به ۵ گیگابایت است، بنابراین دانلود آن زمان می برد.

۸- پس از تکمیل دانلود، می توانید از Llama 3 8B استفاده کنید و مستقیماً در پنجره خط فرمان با آن مکالمه کنید. به عنوان مثال، می توانید از مدل بپرسید که شما کی هستید؟ و برای دریافت پاسخ Enter را فشار دهید.

۹- اکنون می توانید گفتگو را ادامه دهید و از مدل های هوش مصنوعی در مورد موضوعات مختلف سؤال بپرسید. فقط به خاطر داشته باشید که Llama 3 می تواند اشتباه کند، بنابراین هنگام استفاده از آن باید مراقب باشید.

۱۰- همچنین می توانید با مراجعه به صفحه کتابخانه مدل Ollama مدل های دیگر را امتحان کنید. علاوه بر این، دستورات مختلفی وجود دارد که می توانید برای آزمایش عملکردهای مختلف که Ollama ارائه می دهد، اجرا کنید.

۱۱- همچنین میتوانید در حین اجرای یک مدل، عملیات مختلفی مانند تنظیم متغیرهای جلسه، نمایش اطلاعات مدل، ذخیره یک جلسه و غیره انجام دهید.

Ollama -12 همچنین به شما امکان می دهد از مدل های هوش مصنوعی چندوجهی برای تشخیص تصاویر استفاده کنید. به عنوان مثال، مدل LLava می تواند تصاویر تولید شده توسط DALLE-3 را تشخیص دهد. می تواند تصاویر را با جزئیات توصیف کند.

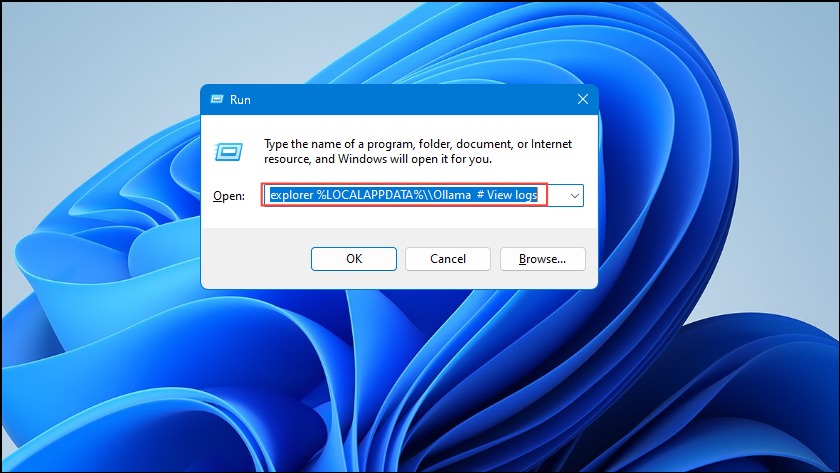

۱۳- اگر هنگام اجرای Ollama با خطا مواجه شدید، میتوانید گزارشها را بررسی کنید تا متوجه شوید مشکل چیست. از میانبر Win + R برای باز کردن Run استفاده کنید و سپس عبارت زیر را قبل از فشار دادن Enter وارد کنید.

explorer %LOCALAPPDATA%\\Ollama # View logs۱۴- همچنین میتوانید از دستورات دیگری مانند explorer %LOCALAPPDATA%\\Programs\\Ollama و explorer %HOMEPATH%\\.ollama برای بررسی باینریها، مدل و کانفیگ مکان ذخیرهسازی استفاده کنید.

توجه: مدلهای کوچکتر هوش مصنوعی مانند Llama 3 8B در صورتی میتوانند روی دستگاه شما اجرا شوند که فقط گرافیک یکپارچه (integrated graphics) داشته باشد. با این حال، اگر یک پردازنده گرافیکی اختصاصی انویدیا دارید، میتوانید مدلهای بزرگتر را با نصب جعبه ابزار CUDA اجرا کنید. همه پردازندههای گرافیکی AMD نمیتوانند مدلهای هوش مصنوعی را اجرا کنند، اما آنهایی که میتوانند نیازی به ابزار خاصی ندارند.

بیشتر بخوانید:

نحوه دانلود و نصب Fooocus | تولید تصویر هوش مصنوعی رایگان و آفلاین

نحوه استفاده از هوش مصنوعی بینگ برای ساخت تصویر

نحوه گسترش عکس توسط هوش مصنوعی